- Kultur

- Digitalisierung

Tanz den Algorithmus

Eine Tagung am Leibniz-Zentrum für Literatur- und Kulturforschung widmete sich der »Algorithmizität als Kultur des Verstehens«. Dabei ging es hauptsächlich um analoge Vorläufer dieser digitalen Technik in der westlichen Kultur- und Geistesgeschichte

Noch vor zehn Jahren mussten sich die »Digital Humanities«, zu deutsch »Digitale Geisteswissenschaften«, den Vorwurf der Theorielosigkeit gefallen lassen – ebenso wie den, dass sie nur den Import digitaler Methoden ohne Erkenntnisgewinn betreiben würden. Der FAZ-Autor Thomas Thiel beschrieb die Gründung der deutschen Sektion der Digital Humanities 2012 gar als eine »Vielzahl genügsamer, pragmatischer Projekte mit überschaubarem Erkenntnisanspruch, die keinerlei theoretische Reflexion erkennen ließen oder durch die affirmative Übertragung technischer Konzepte auffielen«. Anders als in den Sozialwissenschaften, in denen empirische Methoden schon lange zum Standardrepertoire gehörten, ohne dass sie einer Erklärung bedürften und auch Diskussionen über den Positivismus der empirischen Forschung nicht mehr geführt werden, stellt der Import von computerbasierten Forschungsmethoden in den Geisteswissenschaften immer noch ein relatives Novum dar. Obwohl die Digital Humanities inzwischen sowohl durch digitale Editionsprojekte als auch durch eigene Studiengänge deutlich an Umfang und Aufmerksamkeit gewonnen haben, bleibt der Rechtfertigungsdruck gegen den Vorwurf der Theorielosigkeit häufig bestehen.

- Franco Moretti: »Distant Reading«, Verso 2013.

- Felix Stadler: »Kultur der Digitalität«, Suhrkamp 2016.

- Jan Horstmann, Rabea Kleymann: »Alte Fragen, neue Methoden – Philologische und digitale Verfahren im Dialog.

- Ein Beitrag zum Forschungsdiskurs um Entsagung und Ironie bei Goethe«, in: Zeitschrift für digitale Geisteswissenschaften 2019.

- Blog der »AG Digital Humanities Theorie«: dhtheorien.hypotheses.org

In der erwähnten Kritik hatte Thiel die Digitital Humanities noch ermahnt, wollten sie »keine weitere Art der Austreibung des Geistes aus den Geisteswissenschaften sein, müssen sie den Dialog zu den ›traditionellen‹ Kollegen viel stärker suchen«. Und genau dieser Dialog war jüngst Ausgangspunkt der Tagung »Algorithmizität als Kultur des Verstehens? Digitale Erkenntnisprozesse in den Humanities« am Leibniz-Zentrum für Literatur- und Kulturforschung. Hier ging es weniger um die bloße Darstellung der eigenen Methoden und Empirie, vielmehr suchte man nach Vorläufern der Algorithmizität in der analogen Welt – vor allem in der Kultur- und Geistesgeschichte vor der ersten Hälfte des 20. Jahrhunderts. Die Perspektive wurde dabei umgedreht und die eigenen Verfahren und Techniken in einen größeren Kontext gestellt: Nicht die Übersetzung bekannter Theorien und Forschungsfragen in neue empirische Methoden stand im Vordergrund, sondern die Frage, inwiefern »die traditionellen geisteswissenschaftlichen Erkenntnisprozesse selbst als algorithmisch zu denken« sind. Mit anderen Worten: Ob sich Formen der Algorithmizität auch in nicht-digitaler Kultur finden lassen.

Definitionsprozesse

Stellvertretend führten Manuel Burghardt und Silke Schwandt von der »AG Digital Humanities Theorie« diesen Dialog zwischen »der Historikerin« und »dem Informatiker«, die sich über das Verständnis ihrer jeweiligen Disziplin von Algorithmen und Methoden austauschen. Ganz auf dem Stand der digitalen Produktionsmittel im Wissenschaftsbetrieb – und coronabedingt – standen sich die beiden dabei virtuell gegenüber, da die Veranstaltung hybrid stattfand. Der Informatiker lieferte hier die Begriffsdefinition: Ein Algorithmus ist eine Sammlung von systematisch anzuwendenden Regeln, die in Computersprache übersetzt werden müssen, sodass aus einem bestimmten Input ein bestimmter und konsistenter Output erzeugt wird.

Streicht man die Computersprache und betrachtet nur den Grad an Formalisierung und das schrittweise Vorgehen, ist auch die Geschichtswissenschaft anscheinend nicht mehr so weit weg von einem algorithmischen Verfahren. Auch bei der typischen, »standardisierten« Quellenkritik geht die Historikerin schrittweise vor: Sie fragt danach, was für eine Quelle sie vor sich hat, von wann und wo sie stammt, wer darin wen adressiert und warum – und fragt dann, was die Quelle aussagt. Zwar macht man sich in den Geisteswissenschaft nicht immer bewusst, so die Historikerin, wie sehr der eigene Forschungsprozess formalisiert ist oder zumindest formalisiert sein kann, wie sehr man von einem Modell ausgeht, das man auf den konkreten Gegenstand anwendet, und erst Recht legt man keinen Code offen. Aber in den wissenschaftlichen Praktiken, bei denen räumliche und zeitliche Parameter am Untersuchungsgegenstand angelegt werden, ist bereits eine algorithmische Qualität enthalten.

Erkenntnistheoretische Grundlagen

Ob diese algorithmische Struktur, im Sinne der Tagung als »Algorithmizität« bezeichnet, eine Tradition und ein theoretisches und historisches Fundament hat, untersuchte Gabriele Gramelsberger in der Keynote »Algorithmizität – Eine philosophische Perspektive«. Sie begann bei René Descartes und seinem »Discours de la méthode« (vollständiger deutscher Titel: »Abhandlung über die Methode, seine Vernunft gut zu gebrauchen und die Wahrheit in den Wissenschaften zu suchen«). In der Diskussion wurde eingewandt, dieser Anfangspunkt ignoriere die Formen der Algorithmizität in der antiken Philosophie und anderen Kulturen. Aber für Gramelsberger ist Descartes eben der erste, der Gegenstände der Geisteswissenschaften auf eine Weise operationalisierte, systematisierte und ein schrittweises Vorgehen forderte, sodass darin ein »Analysealgorithmus« und damit die Bedingung der Möglichkeit für Algorithmizität angelegt ist. Eine ähnliche »Operationalisierung des Geistes« findet sich zur Zeit der Aufklärung: in der »explizierbaren und formalisierbaren Verstandesoperationen« des englischen Philosophen John Locke und in dem quantitativen Evidenzbegriff seines deutschen Zeitgenossen Gottfried Leibniz. Auch in der formalen Logik des 19. Jahrhunderts gibt es, so Gramelsberger, eine algorithmische Struktur.

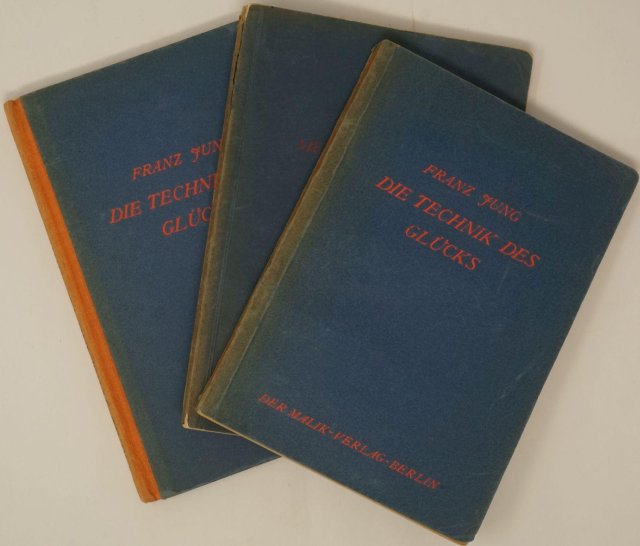

Als Beispiel für Vorläufer der quantitativen Verfahren in den Digital Humanities nannte Gramelsberger das »Häufigkeitswörterbuch der deutschen Sprache« von Friedrich Wilhelm Kaeding. Dabei wurden 1891 und 1897 von über 1000 Personen die Wörter, Silben und Buchstaben noch analog gezählt. Über hundert Jahre später sind digitale algorithmische Techniken wie Wissensgraphen und Künstliche-Intelligenz-Modelle für Wörterbücher wie etwa den Duden selbstverständlich im Einsatz – wobei diese Tools ebenso wenig infrage gestellt werden wie die mit ihnen gewonnene Erkenntnis. Aber Gramelsberger löst den Algorithmus anschaulich von der Digitalität und fasst ihn als etwas Ideelles auf, als formalisierbare Darstellungsmethode. Plastisch wird das etwa an Samuel Becketts Stück »Quadrat I + II«, bei dem vier Darsteller*innen in verschiedenen Farben die Seiten und Diagonalen eines Quadrats nach einem festgelegten Schema ablaufen – eben formalisiert und schrittweise. Das Beispiel des sogenannten Quicksort-Algorithmus, der sich als ungarischer Volkstanz veranschaulichen lässt, wie man auf Youtube sehen kann, zeigt jedoch auch die Grenzen des Erkenntnisgewinns auf: Zwar lässt sich in ihm die Algorithmizität problemlos erkennen. Aber die Kunst erzeugt ihre ganz eigenwilligen Wirklichkeitseffekte, die der Kulturwissenschaftler Diedrich Diederichsen 2017 in seinem Buch »Körpertreffer« als den »Index der Künste« bezeichnet: Ungenauigkeiten, Klecksern und Stolpern – Fehler, die in der digitalen Welt zwar als zufällige »Glitches« (zu deutsch Pannen, Ausrutscher) vorkommen, aber der Regelhaftigkeit von Algorithmen widersprechen.

Interdisziplinäre Betrachtungen

In knapp zehnminütigen »Lightning Talks« setzte sich auf der Konferenz sowohl diese Perspektive auf verschiedene Grade von Formalisierung und Regelhaftigkeit in der analogen Kulturgeschichte fort als auch deren Defizit, Ungenauigkeiten und Fehler zu übergehen, weil sie nicht in die regelhafte Form passen. Einigkeit herrschte mithin über die Notwendigkeit, den Begriff des Algorithmus zu definieren. Ausgehend von den Definitionen ließen sich algorithmische Strukturen wohl auch im musikalischen Denken oder in literarischer Materialität finden – aber ebenfalls um den Preis, nichts Missglücktes oder Uneindeutiges mehr in den Blick nehmen zu können, wie in der Diskussion betont wurde. Den nur scheinbaren Widerspruch aus dem eingangs erwähnten Dialog zwischen »der Historikerin« und »dem Informatiker« illustrierte die Geschichtswissenschaftlerin Charlotte Feidicker in einem Vortrag. Sie modelliert englische Rechtsquellen des 13. Jahrhunderts, um über die Vergleichspraktiken Aufschluss über die Alltagswelt und die Logiken des englischen Rechts zu erhalten.

Das breite Spektrum der Tagung bildete alle Vor- und Nachteile der Interdisziplinarität ab, in diesem Fall des Zusammenspiels zwischen Informatik, Literatur-, Musik-, Geschichts- und Sozialwissenschaft. Aber die Abschlussdiskussion konzentrierte sich auf die Begriffsarbeit an der Kategorie Algorithmizität – und auf das Defizit, das durch das Fehlen einer konsistenten Definition entsteht. Dass die Digital Humanities eine Wissenschaft mit theoretischen Grundlagen sind, müssen sie sich selbst und den anderen Geisteswissenschaften längst nicht mehr beweisen. Lange standen die Digital Humanities mit ihren quantitativen Verfahren vermeintlich im Widerspruch zur Hermeneutik, bei der die Suche nach Sinnzusammenhängen und die Interpretation im Vordergrund stehen. Wie um diesem Vorwurf zu begegnen, schlug die Tagung immer wieder eine Brücke zur hermeneutischen Theoriediskussion. Während so die erkenntnistheoretischen Bedingungen der eigenen Disziplin betrachtet wurden, blieben jedoch gesellschaftliche Verhältnisse gänzlich außen vor. Aber hier unterscheiden sich die Digital Humanities nicht so sehr vom Rest des geisteswissenschaftlichen Feldes.

Wir sind käuflich. Aber nur für unsere Leser*innen.

Die »nd.Genossenschaft« gehört ihren Leser*innen und Autor*innen. Sie sind es, die durch ihren Beitrag unseren Journalismus für alle zugänglich machen: Hinter uns steht kein Medienkonzern, kein großer Anzeigenkunde und auch kein Milliardär.

Mit Ihrer Unterstützung können wir weiterhin:

→ unabhängig und kritisch berichten

→ übersehene Themen aufgreifen

→ marginalisierten Stimmen Raum geben

→ Falschinformationen etwas entgegensetzen

→ linke Debatten voranbringen

Mit »Freiwillig zahlen« machen Sie mit. Sie tragen dazu bei, dass diese Zeitung eine Zukunft hat. Damit nd.bleibt.